La singularité, le chômage et la société

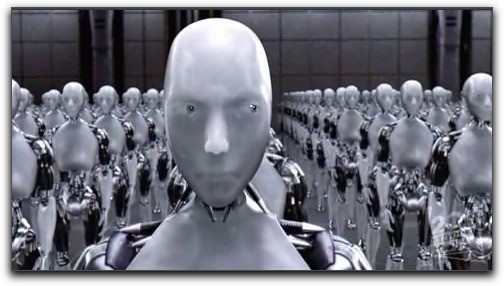

Le concept de Singularité technologique a été évoqué par les savants dès les années 50 par John Von Neumann. Conscients dès cette époque que le progrès technologique s'accélérait, les chercheurs ont imaginé qu'à un certain point de l'histoire (le moment où les intelligences artificielles seront disponibles), le progrès technique irait à une telle vitesse qu'il ne sera plus le fait de l'humain. De nombreux indices nous laissent penser que dès la troisiéme décennie du XXIème siécle, ce point sera atteint. Si la réalisation d'une intelligence artificielle est un défi scientifique et technique passionnant, le défi social posé aux société humaines par la technique est énorme. En quelques mots : Les machines resteront-elles à notre service ?

L'homme a acquis la maîtrise de l'outil il y a fort longtemps, mais ce n'est qu'au XXème siècle qu'il a imaginé pour la première fois que ses outils pourraient le surpasser intellectuellement. Lorsque l'homme a découvert l'informatique au travers des travaux d'Alan Turing, de Von Neumann et de bien d'autres scientifiques, il s'est soudain mis à penser qu'il était possible de bâtir une "intelligence artificielle". Ces chercheurs, aussi brillants qu'ils aient été ont péché par optimise. Et si Stanley Kubrick prévoyait pour 2001 un ordinateur intelligent (HAL 9000), nous avons depuis constaté à quel point la réalisation d'une intelligence artificielle était plus complexe que prévu.

Pourtant, le travail a continué. A tel point que de nombreux scientifiques pensent aujourd'hui que la singularité technologique sera atteitne entre 2030 et 2040. En fait, nous en sentons déja les prémices. Quelques exemples :

- Google teste une voiture capable de conduire de façon entiérement automatique dans le traffic normal (avec des voitures conduites par des humains). La commercialisation est prévue pour entre 2020 et 2025. Les obstacles à la commercialisation sont aujourd'hui plus de nature juridique que technique. Cette annonce est très significative. La conduite automobile fait appel à de nombreuses compétences au niveau cognitif (vision, analyse de la situation, évaluation des risques, prises de décisions). De plus, ces décisions doivent se prendre en temps réel. Sa réalisation marquera une étape très importante dans le rêve de construire une intelligence artificielle.

- Une machine a gagné face à un humain au jeu télévisé Jeopardy (USA). Contrairement aux échecs dont les régles sont simples à expliquer à un ordinateur, Jeopardy fait appel à la compréhension du langage et à l'utilisation d'une base de connaissances encyclopédiques. Ce succès est symptomatiques du fait que depuis l'an 2000 les recherches en traitement du langage naturel ont énormément progressé (alors qu'elles ont longtemps stagné). La maîtrise du langage est une spécificité humaine et fait la encore appel à des capacités cognitives extrémement complexes.

- Dans un domaine qui en apparence n'a rien à voir, les recherches en matiére de "cloud computing" promettent de mettre à disposition des applications des capacités de calcul et de stockage jusque là difficilement envisageable. Or, la capacité de calcul est le nerf de la guerre en IA, de même que la capacité à stocker de grandes bases de conaissances. Si la loi de Moore à elle seule ne permettait pas d'envisager la résolution de certains problèmes, l'utilisation du cloud afin de distribuer les calculs va permettre d'ici quelques années de donner accès à des ressources impressionnantes aux applications. De quoi relancer la recherche en IA et autoriser des applications encore plus impressionnantes.

On le voit, l'état actuel de la recherche et des technologies nous montre que nous nous approchons à grande vitesse de ce que l'on appelle l'intelligence artificielle "faible" c'est-à-dire la capacité de programmer des machines pour qu'elles résolvent une tâche donnée (nécessitant de l'intelligence).

Certes, personne ne peut pour l'instant dire si nous atteindrons rapidement le statut où une machine sera capable de créativité (autre que par exploration d'un espace aléatoire) ou de se fixer ses propres buts, d'avoir une conscience. (ce que l'on appelle l'intelligence artificielle "forte"). Mais le fait d'atteindre déja ce stade de développement constituera à coup sûr le franchissement de la singularité technologique. De la conduite automobile au diagnostique médical, en passant par l'analyse de documents juridiques, on découvrira alors que la plupart des problèmes qui autrefois nécéssitaient une intelligence et des études supérieures peuvent être résolus par des machines. En appliquant ces techniques à la recherche et développement, le progrès technique va alors connaître une accélération phénoménale capable de s'auto-entretenir. Nous serons alors dans un monde différent.

Ce premier stade sera extrémement disruptif sur les rapports sociaux. Dès 1995, les grands de ce monde, réunis en Californie sous l'égide de la fondation Gorbachev ont pris conscience que dans un futur proche, le taux de chômage risquait d'atteindre les 80%. Zbigniew Brezinski, ancien conseiller de Carter et fondateur d'un puissant think tank américain (la Trilatérale) a proposé en solution : le titytainment : Abrutir les 80% restant de divertissements débiles pour qu'ils restent calme. Une solution peu satisfaisante sur le plan humain, héritée de la rome antique (du pain et des jeux) qui à coup sûr conduira notre civilisation au déclin. Mais cette "solution" montre surtout que face au changement à venir lié à la singularité, aucune solution sociale n'a pour l'instant été pensée ! Car dès que l'homme saura développer des IA "faibles", le taux de chômage va augmenter de façon exponentielle ce qui imposera de revoir le rôle du travail dans la société. La survenue de troubles sociaux et géopolitiques graves est en tout cas assurée. La seule incertitude concerne leur taille.

Ce premier stade sera extrémement disruptif sur les rapports sociaux. Dès 1995, les grands de ce monde, réunis en Californie sous l'égide de la fondation Gorbachev ont pris conscience que dans un futur proche, le taux de chômage risquait d'atteindre les 80%. Zbigniew Brezinski, ancien conseiller de Carter et fondateur d'un puissant think tank américain (la Trilatérale) a proposé en solution : le titytainment : Abrutir les 80% restant de divertissements débiles pour qu'ils restent calme. Une solution peu satisfaisante sur le plan humain, héritée de la rome antique (du pain et des jeux) qui à coup sûr conduira notre civilisation au déclin. Mais cette "solution" montre surtout que face au changement à venir lié à la singularité, aucune solution sociale n'a pour l'instant été pensée ! Car dès que l'homme saura développer des IA "faibles", le taux de chômage va augmenter de façon exponentielle ce qui imposera de revoir le rôle du travail dans la société. La survenue de troubles sociaux et géopolitiques graves est en tout cas assurée. La seule incertitude concerne leur taille.

La route vers l'IA forte est plus incertaine car on ne sait pas encore si l'homme parviendra à surmonter ces problèmes sociaux et à inventer une nouvelle société. La recherche pourrait donc bien se trouver stoppée d'un coup net. Mais on peut partir du principe que si certains pays ne passeront pas la singularité et seront détruit par des révolutions ou des guerres, d'autres passeront au travers des troubles et connaitront une prospérité nouvelle. Ces sociétés seront alors confrontées à un problème de type nouveau. Car à coup sûr, les scientifiques vont alors se pencher sur le problème ultime : Une machine peut-elle avoir une conscience ? Peut-elle se fixer ses prorpres buts ? On disposera alors de moyens inégalés pour ces recherches et celles-ci risquent d'aboutir très rapidement. Probablement avant que l'homme n'ait eu le temps de se poser les bonnes questions. A ce moment là, les machines resteront-elles à notre service ?

Que faire ?

Ce texte est un appel. La survenue prochaine de la singularité technologique est maintenant quasi-certaine. Or, nos sociétés ont choisi d'ignorer la technologie dans leur décisions politiques. Rien n'est plus dangereux. L'arrivée de cette révolution technologique est porteuse d'espoir. Si le passage est bien maîtrisé par nos sociétés, celles-ci atteindront un niveau de vie inespéré et l'on peut espérer que de nombreux problèmes sociaux seront résolus. Mais si le changement n'est pas accompagné et anticipé, ce sont des troubles sociaux et géopolitiques très graves qui nous attendent.

La singularité ne pourra pas être datée. On ne se réveillera pas un matin en se disant : "On l'a passée". Il s'agit d'un phénoméne qui couve depuis plusieurs décennies et qui va monter en puissance tout au long des décénies 2010 et 2020. Les troubles sociaux et géopolitiques n'attendront pas 2030 pour survenir. Il est urgent de les anticiper. Cela veut dire réfléchir au rôle du travail dans la société à venir (et peut être penser au dividende universel), réfléchir aux efforts à faire en matière d'éducation et de formation et aider plutôt que lutter à la mise en place de cette nouvelle société qui arrivera qu'on le veuille ou non. Et commencer à réfléchir de ce que l'on fera une fois que l'on aura les moyens de créer des machines plus intelligentes que les hommes. Est-ce que les lois de la robotique d'Asimov suffiront ? Une de nos créations ne risque-t-elle pas d'apprendre à désobéir à ces lois ? En quelques mots : Il faut accompagner le changement. Si la politique doit avoir un sens au XXIème siécle, c'est sûrement celui-là. Malheureusement, si rien ne change et que les problématiques technologiques ne sont pas mises au centre de la politique, nous n'attendrons pas 2020 avant que les premiers troubles graves se manifestent. Peut-être ne les identifierons nous pas comme des conséquences de l'accélération du progrès. On blamera sûrement la Chine, les Banques, les politiques, la dette publique. Peut-être même fera-t-on la guerre à cause de cela. Lorsqu'un tsunami arrive, il faut prendre de l'altitude. Sinon il nous balaye.

Quelques liens :

La singularité technologique sur Wikipédia

http://fr.wikipedia.org/wiki/Singularit%C3%A9_technologique

Le titainment :

http://www.technikart.com/archives/2085-linformation-est-lopium-du-peuple

L'intelligence artificielle Watson :

http://fr.wikipedia.org/wiki/Watson_%28intelligence_artificielle%29

La voiture sans pilote de Google :